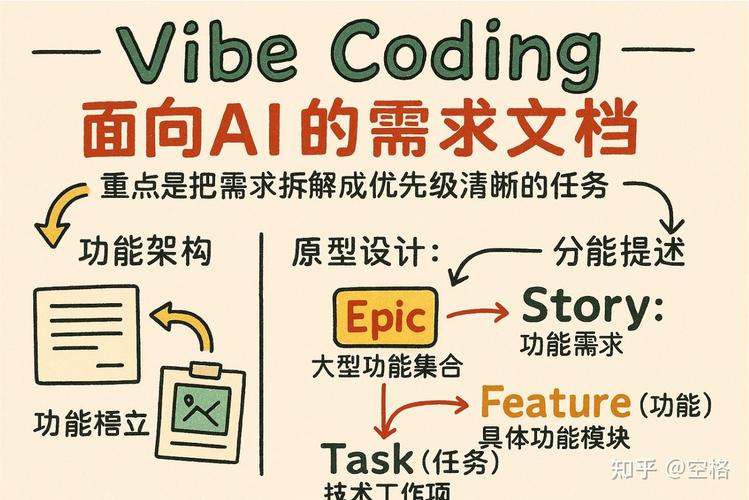

linux与shell编程指南 Vibe Coding时代:AI助力Linux安全运维,告别传统痛点

Vibe 时代,如何让 AI 安全地替我们操作 Linux引言:运维之痛与 AI 的曙光

身为开发者,我们大概都有过这样的经历:凌晨两点被告警叫醒,睡眼惺忪地敲下 、、grep 各种命令排查故障;或者在做项目部署时,反复确认 rm -rf 后面有没有多打一个空格。传统 Linux 运维的效率瓶颈和安全风险,早已是每个技术人心中难以言说的痛。

AI 智能体的爆发式发展带来了转机。想象一下:你只需要在终端说一句“帮我排查一下生产环境 API 响应慢的问题”,AI 就自动去查日志、分析指标、给出诊断结论——这不再是科幻,而是正在落地的现实。但问题也随之而来:我们敢把 sudo 权限交给 AI 吗?

答案是可以的,关键在于建立一套多层次的安全防线。下面从原理到实践,梳理一套可落地的方案。

适用场景:本地开发、测试环境、CI/CD 流水线。生产环境建议在此基础上增加人工审批节点。

核心理念:从“信任 AI”到“约束 AI”

安全领域有一条铁律:零信任——不信任任何实体,包括 AI。

传统运维中,我们通过 精确控制权限、通过堡垒机审计操作、通过代码审查规避风险。AI 时代,这套逻辑必须升级:从“相信 AI 不会乱来”,转变为 “无论 AI 意图如何,它都没有机会乱来” 。

根据行业实践,一套完整的 AI 安全操作 Linux 架构包含三层防护:

防线一:代码与命令的安全门禁

AI 最擅长的是生成命令和脚本,但“幻觉”问题始终存在。它可能会拼接出包含 rm -rf / 的危险命令,或者引用了一个带有错别字的恶意软件包(即“”攻击)。

解决方案:在终端集成AI 防火墙或安全拦截器。当 AI 生成的命令即将被执行时,这类工具会在 Shell 层面进行语法解析和风险识别。

以开源工具 为例,它通过 Hook Shell 的方式拦截了 pip、npm、、git、chmod 等 16 种常见命令 :

# 示例1:AI 幻觉导致的错别字包被自动拦截

$ pip install reqeusts

BLOCKED reqeusts

Possible typosquat — similar to 'requests'

Did you mean: requests?

# 示例2:防止权限过度放开

$ chmod 777 app.py

VibeFort: World-writable mode 777 allows any user to modify files

BLOCKED: Fix the issue above before proceeding

开发人员收益:你不用再瞪大眼睛逐字检查 AI 生成的命令,工具会自动识别错别字、恶意包名和权限滥用,把“职业反射”级别的安全审查交给自动化程序。

防线二:沙箱与容器化隔离

对于需要 AI 执行复杂运维任务的场景(如自动修复依赖漏洞、动态扩缩容),仅靠命令拦截还不够。AI 智能体本质上是运行在机器上的代码,完全可能尝试提权或访问敏感文件。

最佳实践:将 AI 智能体关进 容器的“笼子”里,剥夺其所有非必要权限 。

以下是一个为 AI 智能体设计的零特权容器启动模板:

docker run -d --name ai-operator \

--network restricted-net \ # 隔离网络,仅允许访问内部 API

--cap-drop ALL \ # 禁用所有 Linux 内核权限

--security-opt=no-new-privileges \ # 禁止提权

--read-only /sys /bin \ # 关键系统目录只读

--memory=2g --cpus=2 \ # 限制资源配额,防止耗尽系统资源

-v /data/ai-workspace:/workspace \ # 限定可读写的工作目录

ai-agent:latest

关键安全参数说明:

高级方案:对于需要嵌套容器、或运行完全不可信代码的场景,推荐使用 vsbx 这类专用沙箱工具。它基于 Linux 实现毫秒级启动的轻量级隔离,可细粒度限制网络和文件系统访问——比如只允许 AI 写入 /tmp,禁止读取 ~/.ssh 目录 。

防线三:AI 身份的“入职管理”与行为审计

在企业级部署中,AI 智能体数量可能成百上千。我们需要像管理员工一样管理这些“数字运维” 。

核心机制:

独立身份:为每个 AI 智能体分配唯一的 ,而非直接复用人类的 root 或 admin 凭证。最小权限:AI 只能访问完成特定任务所需的资源。比如负责日志分析的 AI,绝不应该拥有修改数据库 的权限 。意图对齐:在执行高风险操作前(如重启服务、删除数据),要求 AI 输出明确的意图并由人类做最终确认,或通过规则引擎校验“任务描述”与“实际操作”是否一致。

审计与回滚:所有 AI 发起的 Shell 会话和 exec 都应该被完整记录(例如使用 命令或审计守护进程)。当 AI 操作造成混乱时,能通过 git 式的机制快速回滚——回滚能力是敢于放权的底气 。

实战:你的 AI 运维助手安全配置清单

如果你现在就想让 AI 帮你分担 Linux 操作,按以下步骤做“安全加固”:

步骤

操作内容

安全效果

1. 安装前置拦截器

开发机安装 或类似 Shell 防护工具

防止 AI 执行 rm -rf / 或安装恶意依赖

2. 配置 AI 专用容器

编写 或 -.yml,按前文模板剥夺权限

隔离文件系统与网络,防止横向移动

3. 实施只读模式

使用 Code 的 Plan Mode 或 的只读分析模式

在规划阶段完全禁止 AI 修改任何文件

4. 建立审批流

在 CI/CD 中增加高危命令审批卡点(如 apply 前)

实现“AI 建议 + 人类确认”的半自动化闭环

5. 升级审计系统

配置审计日志,接入 或 ELK 进行异常行为分析

事后溯源,持续优化 AI 策略

未来展望:AI 对 AI 的攻防战

随着 AI 智能体的普及,安全攻防正在进入“AI vs AI”时代。攻击者会用 AI 自动化扫描漏洞并发起攻击,防御者则依赖 AI 安全智能体以机器速度进行检测和响应 。

对于我们开发者而言,这意味着:

结语

AI 替我们操作 Linux,不是要让我们当甩手掌柜,而是把我们从枯燥的 grep 和 sed 中解放出来,去思考架构和业务。安全的本质从来不是拒绝新技术,而是用可控的风险去换取更高的效率。

现在,你可以在终端里自信地敲下:Hey AI,帮我优化一下 Nginx 配置——前提是,你已经给它穿上了防弹衣。

附:工具速查表

工具

核心用途

适用环境

Shell 层命令拦截,防恶意包/危险命令

macOS / Linux 开发终端

+

容器化沙箱,系统级权限隔离

服务器 / CI 流水线

CLI

代码安全扫描 + AI 辅助修复

代码仓库 / IDE 插件

多智能体安全编排与合规审计

大型混合云基础设施

Code Plan Mode

只读分析模式,零修改风险

AI 规划与代码审查阶段